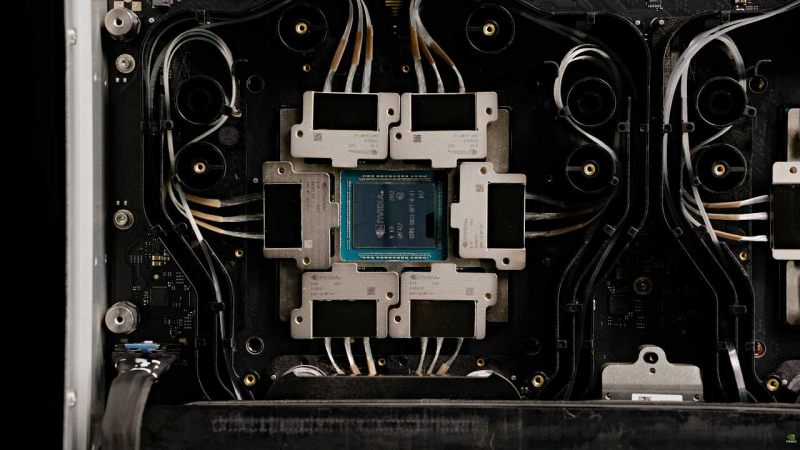

엔비디아가 차세대 데이터센터 GPU Feynman에 코패키지드 옵틱스 기술을 적용할 것으로 알려졌다. CPO는 실리콘 포토닉스 기반 광 연결 기술로, 기존 구리 케이블 중심의 데이터 전송 구조를 대체해 AI 데이터센터의 대역폭과 지연시간 문제를 줄이는 데 초점을 맞춘다.

NVIDIA will introduce co-packaged optics with its 2028 Feynman GPUs, accelerating optical interconnect adoption to reduce copper dependence and support high-bandwidth AI data center scaling.

CPO는 GPU 같은 하드웨어 가속기와 광 입출력 모듈을 같은 패키지에 배치하는 방식이다. 전기 신호 대신 빛을 활용해 데이터를 전송함으로써 장거리·고속 연결에서 발생하는 손실과 전력 소모를 낮출 수 있다. CPU와 GPU, GPU 간 연결이 대규모로 확장되는 AI 팩토리 환경에서 핵심 기술로 꼽힌다.

당초 CPO 상용화 시점은 2033년 전후로 예상됐지만, 엔비디아는 Feynman GPU 도입 시점인 2028년으로 일정을 앞당긴 것으로 전해졌다. AI 인프라가 수천·수만 개 가속기를 연결하는 구조로 확대되면서 플랫폼 간 거리가 10km 이상으로 길어지고, 수백Gbps 이상의 고속 데이터 전송이 필요해졌기 때문이다.

업계는 광 연결 표준화를 위한 움직임도 본격화하고 있다. 엔비디아, 브로드컴, AMD, 메타, 오픈AI, 마이크로소프트 등이 참여한 Optical Compute Interconnect Multi-Source Agreement는 AI 데이터센터용 광 연결 생태계 구축을 목표로 한다. 엔비디아는 이 흐름 속에서 Feynman 세대에 첫 CPO 기반 솔루션을 도입할 전망이다.

Feynman GPU는 3D 다이 스태킹 기술도 적용할 것으로 알려졌다. 이는 여러 반도체 다이를 수직으로 적층해 연산 밀도와 데이터 이동 효율을 높이는 패키징 방식이다. 엔비디아가 인텔 파운드리의 EMIB 같은 첨단 패키징 기술을 활용할 가능성도 제기된다.

메모리 구성도 변화가 예상된다. Rubin은 HBM4, Rubin Ultra는 HBM4E를 활용할 것으로 알려진 가운데, Feynman은 표준 HBM 대신 맞춤형 HBM 기술을 사용할 가능성이 거론된다. 이는 HBM4E를 강화한 형태이거나 HBM5 기반의 커스텀 메모리 구성이 될 수 있다.

Feynman 세대에는 새로운 데이터센터 CPU Rosa도 함께 쓰일 전망이다. 기존 Vera CPU가 아닌 신규 CPU 아키텍처를 적용해 GPU, CPU, 메모리, 네트워크를 통합한 AI 플랫폼 성능을 끌어올리는 방향이다.

엔비디아는 Feynman과 함께 BlueField-5, NVLink 8 CPO, Spectrum 7 204T, ConnectX-10 등 AI 데이터센터용 칩과 네트워크 제품군도 전개할 것으로 예상된다. CPO가 NVLink와 이더넷 스위칭 계층까지 확대될 경우, AI 클러스터의 병목으로 지적되는 데이터 이동 비용과 연결 지연을 줄일 수 있다.

AMD도 글로벌파운드리와 협력해 자체 CPO 기술을 준비 중인 것으로 알려졌다. 첫 적용 시점은 MI500 GPU가 등장할 것으로 예상되는 2028년 전후가 거론된다. AI 가속기 경쟁이 연산 성능에서 메모리, 전력, 광 연결 기술로 확대되면서 차세대 데이터센터 설계 경쟁은 더 복잡해질 전망이다.